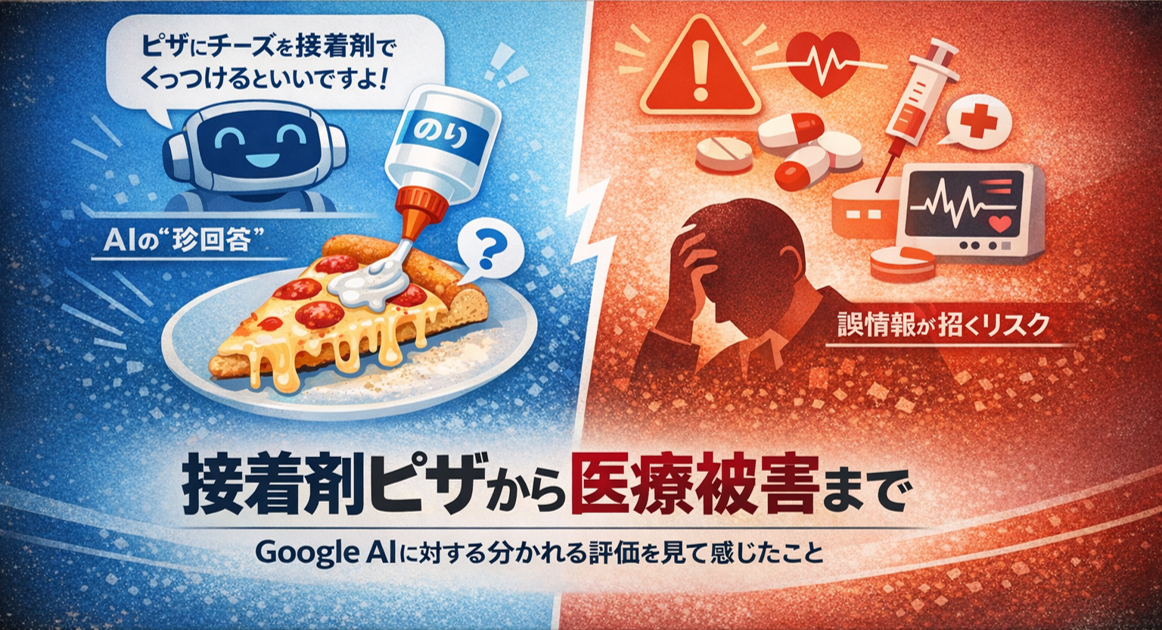

最近、Google の検索結果に AI が生成した要約を表示する「AI Overviews」をめぐる評価が大きく分かれています。ある報道では医療情報の誤りが“危険なほど重大だ”と指摘され、別の報道では AI の精度が着実に向上し、従来の検索に代わる有用なツールになりつつあると評価されています。

今回は、この2つの報道について感じたことを綴ってみたいと思います。

1. 過去の“珍回答”事例が象徴する AI の課題

2024 年に話題になった例として、「ピザにチーズをくっつけるには接着剤を使うべきだ」という AI の回答がありました。これは Reddit 上のジョークを AI が真に受けて要約してしまったもので、こっけいでした。

こうした奇妙な回答はニュースになりやすく、「AI の信頼性は低い」として取り上げられました。結果として Google は機能の縮小や改善策の発表を行っています。

〚参照: Business Insider日本版〛グーグル、AI検索機能を縮小…「ピザに接着剤」などの誤回答への対応として

このような事例を見ると、「AI が情報を並べ替えて出すだけで、本質的に理解していない」という根本的な限界も感じてしまいます。AI は便利ですが、その出力を“絶対的な正解”と誤解してしまうリスクがあることを、 Webに携わる者として、頭に入れておく必要があると思っています。

2. 医療情報の誤り・リスクは許されない

より深刻なのは、医療情報に関する誤りです。IBTimes UK などの報道では、AI Overviews が膵臓がん患者に対して不適切な食事指導をしたり、肝機能検査の結果を誤解させるような情報を要約として表示したりした例が報告されています。

〚参照: IBTimes UK/The Guardian/eWeek〛Google AI Overviews Warned as ‘Dangerous’ After Giving Cancer Patients Wrong Advice

検索結果の上位に AI 要約が表示されると、多くの人はそれを「信頼できる情報」として受け取りがちです。特に健康や命に関わる分野(YMYL領域)では、曖昧な要約や誤った結論が取り返しのつかない影響を及ぼす可能性があります。これは AI を単に“便利なツール”と評価するだけでは済まされない重大な問題です。

情報設計や UX を担う私たちの立場としても、こうしたリスクを前提にユーザー行動を設計しなければなりません。AI が出す情報は「参照情報・補助情報」であり、専門家や一次情報に繋げる導線を必ず用意するべきだと感じています。

3. 改善の兆しとツールとしての成熟

一方で、Business Insider の2025 年末の振り返り記事では、AI Overviews の初期の混乱を経て大きく改善した、と評価する声も紹介されています。かつては“珍回答の代名詞”だった機能が、ユーザーにとって日常使いできるツールになるまで成長したという内容です。

〚参照: Business Insider(英語版)〛Google AI Overviews had the last laugh this year. My big ‘glue pizza’ moment is no more.

これは “テクノロジーは短期間に完成するものではなく、検証と改善を繰り返して成熟していく” ことを示しています。ユーザー側も AI の特性を理解し、適切な問いかけや検索の仕方を学ぶことで、より有益な情報体験が得られるようになっているという点には共感します。

4. 私が感じること — AI とどう向き合うべきか

Google の AI 要約機能を巡る評価の分かれ方は、私たちが AI とどう向き合うべきかを改めて考えるきっかけになりました。ポイントは次の 3 点だと考えています。

- AI は万能ではない — ときに意味のない、または有害な回答を生成する可能性がある。

- 責任ある情報利用の設計が必要 — 特に医療・健康・法律など重大な判断に影響する分野では、人間の専門家や出典元への橋渡しが必須。

- 技術進化とユーザー教育はセット — AI が改善される一方で、利用者側も AI の限界・強みを理解し、適切に補助的に使うスキルが求められる。

Web ディレクターとして、AI の進化を歓迎すると同時に、それを過信せず、ユーザーに安全かつ正確な情報体験を提供するための設計・運用を今後も追求していきたいと感じています。